その利点にもかかわらず、AI技術の採用はしばしば重大な障害に直面します。それは、従業員の間での信頼と理解の欠如です。最新の調査 アーンスト・アンド・ヤング LLPによる は示しています アメリカの労働者の約71% は、AIが彼らの雇用の安定性とプライバシーに及ぼす影響について懸念を示しています。これらの懸念に対処することは、AIの能力を最大限に活用しようとする組織にとって重要です。企業が従業員の間で信頼を築き、AIの採用を促進する方法は以下の通りです。

従業員を教育し、関与させる

懐疑心を克服するための第一歩は教育です。従業員は、AIがどのように機能するか、その利点、制限を理解する必要があります。組織のリーダーは、AIを解明し、各自の役割における実用的な応用を示すために、研修セッション、ワークショップ、セミナーを促進すべきです。

実際の成功事例を紹介する

技術に対する信頼を築くのは、具体的な成功事例ほど効果的なものはありません。AIが職務の向上、効率の向上、複雑な問題の解決に寄与したケーススタディを強調することで、従業員の信頼と好奇心を刺激することができます。AIの導入が特定のタスクで40%の時間節約をもたらしたという統計を共有することは、AIの価値を具体的に示す証拠となります。

透明な実装

透明性はあらゆる技術の実装において重要であり、AIの場合は特に重要です。組織はAI統合の目的、さまざまな役割への影響、および従業員のデータとプライバシーを保護するための措置について明確であるべきです。透明なアプローチは従業員を安心させ、仕事の喪失やデータの悪用に関連する不安を軽減します。

フィードバックとコラボレーションを促進する

AIの導入は協力的な努力であるべきです。実装の各段階で従業員からのフィードバックを促すことで、懸念を迅速に特定し対処することができます。また、AI戦略を労働力のニーズや快適さにより適合させるための調整を可能にし、技術が置き換えではなく支援のためのツールとして使用されることを保証します。

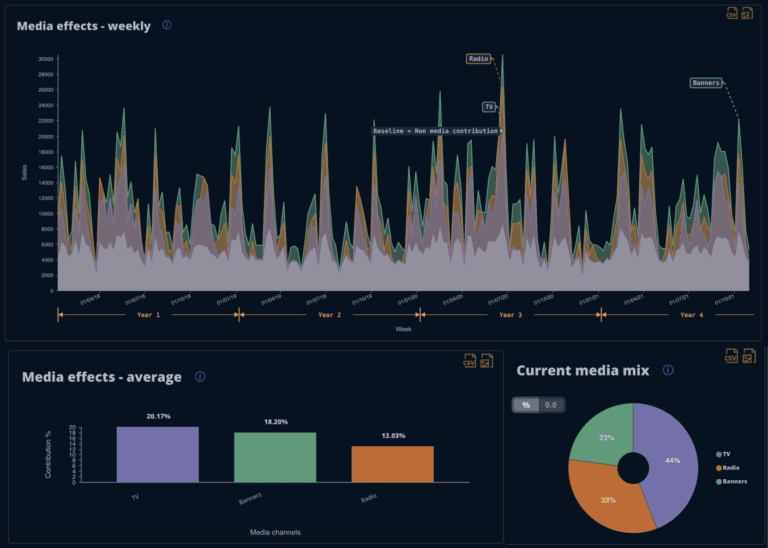

データに関するチームメンバー間のコラボレーションを促進するために、 Next Brain どこからでも更新されたデータインサイトへのリアルタイムアクセスを可能にするインタラクティブダッシュボードを活用します。

倫理的なAIプラクティスを実装する

倫理的な考慮は信頼を築く上で重要な役割を果たします。組織は倫理的なAIプラクティスを遵守し、AIシステムが公平で透明かつ説明責任を果たすことを保証する必要があります。倫理的なAI使用に関する明確なガイドラインを確立し、これらの議論に従業員を参加させることで、信頼を強化し、AI技術のよりオープンな受け入れを促進できます。

+34 910 054 348

+34 910 054 348 +44 (0) 7903 493 317

+44 (0) 7903 493 317